総務省と経済産業省が連名で「AI事業者ガイドライン」を提供しています。バージョン1.0は今年の4月、少しの修正が加えられたバージョン1.01が11月にリリースされています。

このガイドラインは、AIのツールを紹介したり、便利な使い方を説明するものではありません。もともと、AI開発ガイドライン、AI利活用ガイドライン、AI原則実践のためのガバナンス・ガイドラインとして提供されていたものを一つにまとめたものであり、AIがもたらす便益とリスクのバランスを取って、企業(事業者)がしっかりガバナンスを効かした形でAIを使っていくためのガイドラインです。

どうしてもリスクが強調されがちな内容になっているのですが、リスクを恐れるあまりに、AI活用を避けるような態度も良くないと釘を刺しています。

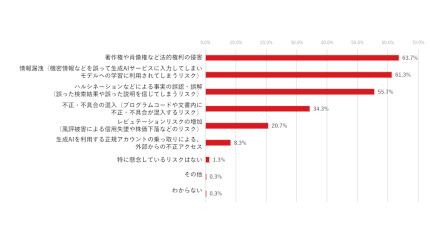

企業における生成AI活用のついてのアンケート結果では、有用性は評価される一方で様々なリスクを感じて、実際の活用には二の足を踏んでいるというようなものを見かけます。個人での活用は積極的になれても、企業としての活用は慎重にならざるを得ない側面はやむを得ないところであり、だからこそ、しっかりリスクを評価して、その対応を行った上で安心して活用することが必要なのかもしれません。

そういう意味では非常に重要に感じられるこのガイドラインなのですが、どのように使っていけば良いのでしょうか?

AI事業者とは誰か?

AI事業者ガイドラインでは、AI事業者として下記の3種類を定義しています。

- AI開発者 AIシステムを開発する事業者

- AI提供者 AIシステムをアプリケーション、製品、既存のシステム、ビジネスプロセス等に組み込んだサービスとして利用者に提供する事業者

- AI利用者 事業活動においてAIシステム又はAIサービスを利用する事業者

AIシステムやサービスを開発・提供する事業者だけでなく、AIシステムやサービスを利用のみの場合も事業活動において利用するのであればAI事業者になりますから、今後は、ほとんどの企業がAI事業者ということになるでしょう。

AIガバナンスシステムを構築する

AI事業者は、原則としてAIガバナンス・ゴールを策定し、ガバナンスシステムを構築する必要があります。AI事業者ガイドラインでは、AIガバナンス・ゴールを策定しないAI事業者は、その理由をステークホルダーに説明できるようにする必要がある、としています。

環境・リスク分析

AIガバナンス・ゴールを設定するには、まず環境・リスク分析を行います。

環境・リスク分析を行うには、そもそもAIをどのように事業活動に導入していくのか、AIの用途を決める必要があります。それによって、自社がAI開発者なのか提供者なのか利用者なのかも決まってくるでしょう。

AIに用途を見出すということは、その用途におけるAIの便益があると認識しているということでしょう。当然に、何らかの便益があると思ってAIを事業に導入しようと考えるわけです。

一方で、AI導入に関するリスクも分析する必要があります。個人情報や機密情報を取り扱うような業務では、その流出を防ぐ仕組みが必要になります。生成AIではハルシネーション、認識・予測AIでも誤認識や予測誤差は当然に発生しますから、その対応も必要でしょう。AI活用の中に人間を取り込む「Human In The Loop」のような考え方も参考になります。他にも、AIで使用するデータとして誤ったデータを使用するデータ汚染問題や、人間の専門家の仕事を一部代替するような「Expert In The Loop」を検討している場合は、専門家の資格(医師や弁護士業務を行うために必要な資格)の法律との衝突を避ける対応も必要となります。

また、リスクの分析においては「AIの社会的な受容」を理解し、検討する必要もあります。技術的に実現でき、上記のような直接的なリスクの対策を充分行ったとしても、そのAIシステムやサービスが社会的に受け入れられるものかという問題は残っています。社会的な受容が難しいAIシステムやサービスを開発・提供または事業の中で利用すると、社会的な批判を受けたり、ビジネス的に失敗してしまうことになります。

AIの事業導入においては、この便益とリスクのバランスを考える必要があるわけです。一方で、リスクゼロになるまで手を出さないという判断にも問題があります。便益を充分に享受し、事業に好影響を与えるためには、リスクがあることを認識しつつ、そのリスクに対応していくためのガバナンスシステムを構築することによって、リスクを制御していくという考え方が必要です。

リスクにどのように対応するか、対応できるか検討する

AIを事業に導入し、しっかり便益を引き出しつつ、リスクを制御して行くには、自社のAIについての成熟度を評価する必要があります。自社のAI成熟度が高ければ、AIの便益を享受しリスクを制御できる可能性が高まります。

ただ、最初からAI成熟度が高い組織は存在しません。企業の中でリスクの低い部分からAI導入を始め、徐々に慣れていくことで、AI成熟度を高めていくという発想が必要です。もちろん、教育を行うとか、外部の専門家の支援を受けるといったことも重要です。

AIガバナンス・ゴールを策定する

こうした自社のAI成熟度の理解を含めた便益とリスクの分析を行った上で、AIガバナンス・ゴールを策定します。

AIガバナンス・ゴールを策定するには、AI事業者ガイドラインの「共通の指針」や、AI開発者、AI提供者、AI利用者ごとに定義された重要事項をベースに検討すると良いでしょう。

共通の指針は下記のようなものです。

人間中心 AIによる意思決定・感情の操作への留意、偽情報対策など

安全性 人間の生命・身体・財産・精神・環境への配慮、適正利用、適正学習

公平性 バイアスへの配慮、人間の判断の介在

プライバシー保護 AIシステム・サービス全般のプライバシー保護

セキュリティ確保 AIシステム・サービス全般のセキュリティ確保、最新動向の留意

透明性 検証可能性、情報提供、合理的かつ誠実な対応、説明可能性・解釈可能性の向上

アカウンタビリティ トレーサビリティ、「共通の指針」の対応状況の説明など

教育・リテラシー AIリテラシーの確保、教育・リスキリングなど

公正競争確保

イノベーション オープンイノベーション、相互接続性・相互運用性、適切な情報提供

また、AIガバナンス・ゴールは、自社の経営理念と紐付けると、より効果を発揮します。企業及び経営者として、どのような方針で経営を行うかの考え方(経営理念)があると思います。AIはその経営理念を実現するためのツールですから、経営理念に基づいたAIガバナンス・ゴールであるべきなのです。

小規模事業者におけるAIガバナンス・ゴールの策定例として、AI事業者ガイドラインでは下記のような例が挙げられています。

当社は、AIシステムの開発を始めて間もないものの、自社の開発するAIシステムのリスクは軽微ではないため、AIガバナンスへの取組を始めることとした。しかし、従業員数も少ないため、AIガバナンス担当者等を特別に設定することは難しい。よって、経営者にて、自社の経営理念とも紐付けた「自社としてのAI開発の在り方」を描いた上で、現場担当者に共有した。その後、経営層及び従業員で、実際に起きたインシデントについても共有しながら、「自社としてのAI開発の在り方」のブラッシュアップ及び全社としての目線合わせを行った。結果として、A4一枚程度の内容ではあるものの、これを自社のAIガバナンス・ゴールとすることとした。

立派な文書を作るというよりは、血の通った内容を作ることが重要ということでしょう。

企業経営にAIガバナンスシステムを取り込む

AIガバナンス・ゴールを策定したら、現状のAIシステム・サービスと、AIガバナンス・ゴールとの乖離を特定・評価します。リスクが存在する場合は、そのリスクを自社が受け入れられるかを検討します。受け入れられないリスクが判明した場合は、開発・提供・利用のあり方を再考する必要があります。

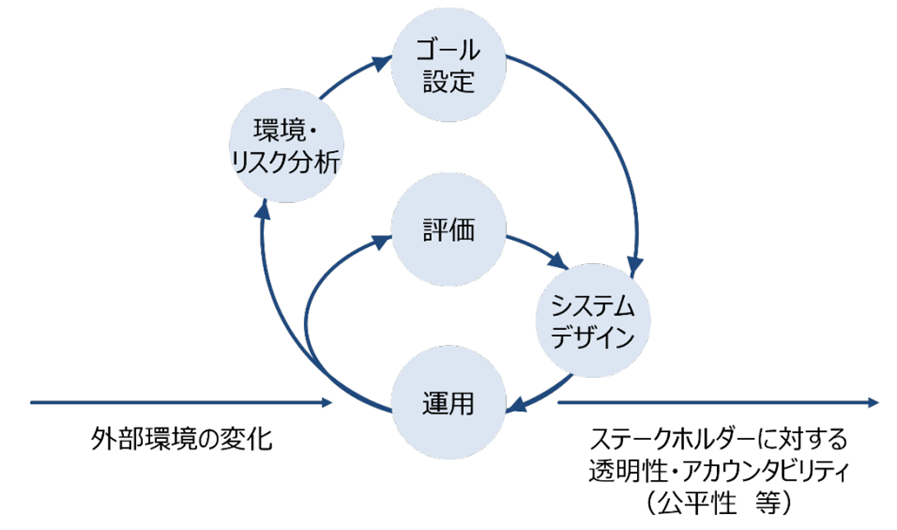

このようなリスク判定と再考のプロセスを経営に組み込むことが、AIガバナンスシステムの構築です。経営層がリーダーシップを取って継続的に実施するため、経営会議等で定例的に検討するといった対応が必要です。また、AI成熟度を組織として向上させていくための取り組みも必要ですし、社内でAI開発者・AI提供者・AI利用者の複数の主体が存在する場合は、その情報交換も重要でしょう。また、環境・リスク分析は定期的に行うため、日常的な情報収集・意見交換を奨励すると良いでしょう。

AIガバナンスを定期的に評価する

このように構築したAIガバナンスシステム自体の定期的な評価も必要です。AI導入の幅・深さが広がったり、自社のAI成熟度が向上したりすると、当初設定したAIガバナンス・ゴールが相応しくないものになっている可能性もあります。他社の事例を参考にしたり、AI事業者ガイドラインで定義された指針との乖離についても検討すると良いでしょう。

AIの便益とリスクを定期的に分析する

AIガバナンスシステムは、先ほどの図のようにアジャイルループであるべきです。AI技術や社会のAI受容度、他社事例などは、どんどん進展・変化していきます。そのため、上記のように日常的な情報収集・意見交換を行い、新たな知見を得て、それに基づいて便益とリスクの定期的な分析を行う必要があります。このような活動を定期的に行うことで、自社のAI成熟度も向上していくでしょう。

まとめ

私はITコーディネータとしてAI導入のご相談を受けることがありますし、弊社(株式会社ビビンコ)では生成AI利活用クラウドサービス「Gen2Go」の開発・提供をしていることもあり、弊社自身または支援先様がAI開発者・AI提供者・AI利用者のいずれかである、もしくはいずれかになっていくという状況にあります。

AI事業者ガイドラインで述べられているように、ただAIを導入するというだけでなく、自社がAI事業者であると認識し、しっかりAIの便益を享受しながら、リスクにも対応していく必要性があります。弊社自身がしっかりAIガバナンスシステムを構築し、運用していきつつ、支援先に対してもAIガバナンスシステムの構築にご協力する必要があると感じています。